In diesem Teil stürzen wir uns in zwei der gebräuchlichsten Verfahren innerhalb der Psychologie, nämlich den t-Test für unabhängige Stichproben sowie die einfache und multiple Regression. Wenn du diese Methoden gut beherrschst, bist du schon recht gut aufgestellt: du kannst dann mit dem t-Test die Mittelwerte zweier Gruppen vergleichen ("Sind Männer optimistischer als Frauen?") und mit der Regression ganz ohne Glaskugel Vorhersagen machen ("Lässt sich die Hilfsbereitschaft aus der Empathiefähigkeit, der Sensibilität und dem Geschlecht vorhersagen?"). Das ist doch was, oder?

Damit du alles selbst nachvollziehen kannst, schreibe ich dir wie üblich die jeweiligen Schritte dazu, um die abgebildeten Ergebnistabellen zu erhalten.

Dabei gehe ich davon aus, dass du statistisches Vorwissen hast und dich mit der grundsätzlichen Bedienung von SPSS auskennst. Natürlich kannst du dir alles auch nur so durchlesen, ohne die Daten selbst aufzurufen.

Nachlesen kannst du das alles (inkl. Auswertungen mit R) in meinem ganz wunderbaren Buch "Schließende Statistik einfach erklärt! Von Null auf Statistik-Profi mit Schritt-für-Schritt-Anleitungen", das du HIER bekommst.

Hast du was anderes gesucht? Klick' hier für SPSS für die deskriptive Statistik, hier für Zusammenhangsmaße sowie hier für die Varianzanalyse.

Wo du Datensätze zum Üben herbekommst

Datensätze bekommst du auf verschiedensten Seiten im Internet sowie direkt im Programm SPSS. Ich empfehle z. B. die Datensätze von Andy Field, die hier zu finden sind.

Praktischerweise liefert SPSS aber auch eine Fülle von Datensätzen mit, die du folgendermaßen erreichen kannst:

Windows: C:/Programme/IBM/SPSS/Statistics/29 (oder eine andere Version)/Samples/German

Mac: Im Finder: Applications oder Programme/IBM/SPSS/Statistics/29 (oder eine andere Version)/Samples/German

Die nachfolgenden Outputs entstammen alle dem Datensatz survey_sample.sav im SPSS-Samples-Folder, der knackige 46 Variablen und 2.832 Fälle aus den USA enthält. Bitte suche und öffne ihn – und los geht's.

t-Test für unabhängige Stichproben

Der t-Test für unabhängige Stichproben untersucht, ob sich zwei Gruppen bezüglich eines bestimmten Merkmals signifikant unterscheiden. Dafür werden zwei Mittelwerte einer normalverteilten metrischen Variable miteinander verglichen.

Er wird verwendet, wenn es um Fragen geht wie: "Unterscheiden sich Frauen und Männer in ihrer sozialen Kompetenz?", "Weisen Jugendliche eine höhere Risikoaversion auf als Erwachsene?" oder "Sind Studierende stärker psychisch belastet als Schüler?".

Das Wort "unabhängig" meint hier, dass bei jeder Person nur eine Messung durchgeführt wird und es sich nicht um die Messungen von eng miteinander verwobenen Menschen handelt, wie z. B. Zweier-Teams oder Zwillinge.

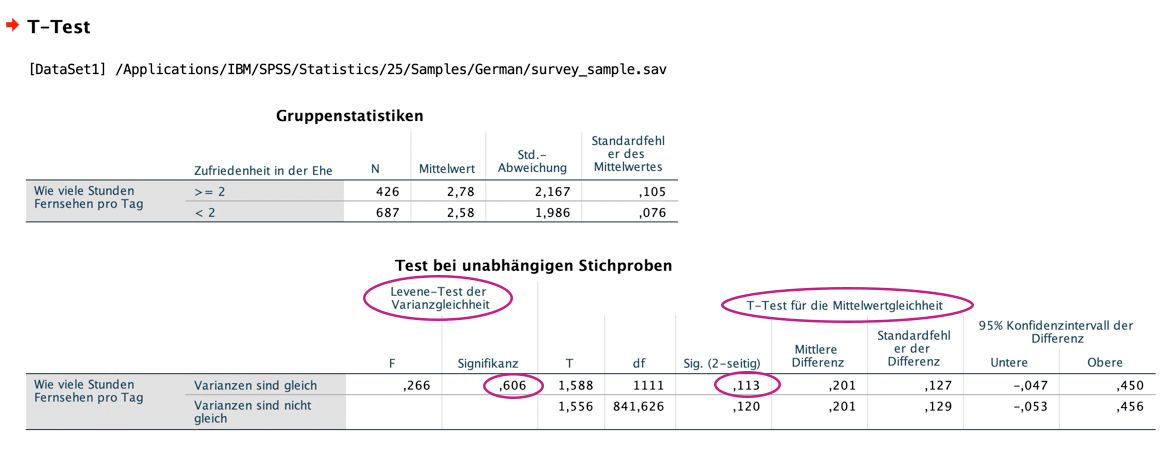

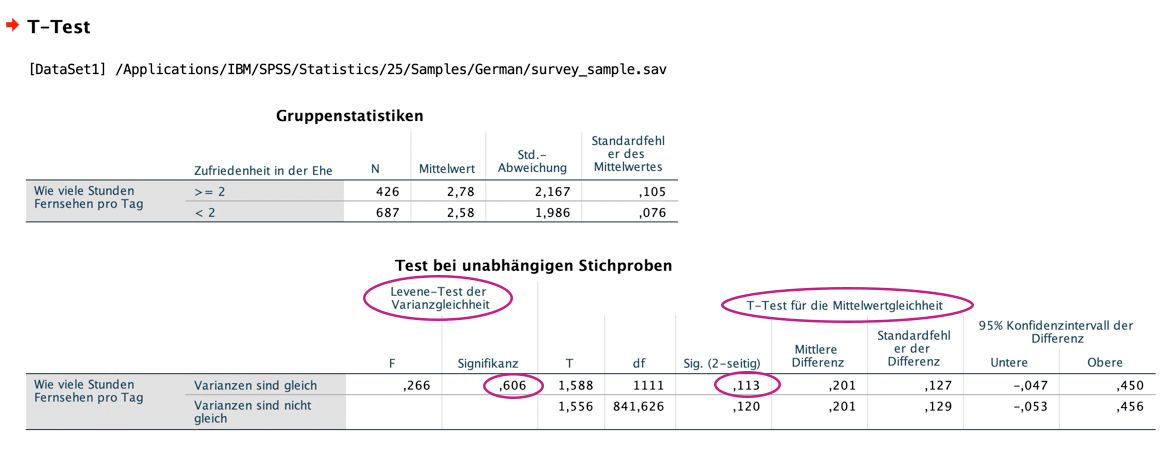

Doch nun zur Umsetzung: Gehe auf "Analysieren", "Mittelwerte vergleichen", "t-Test für unabhängige Stichproben". Im sich öffnenden Fenster verschiebst du in das Feld "Testvariable(n)" diejenige metrische Variable, bezüglich derer sich die beiden Gruppen (vermutlich) unterscheiden. Wir nehmen "Wie viele Stunden Fernsehen pro Tag".

Danach definierst du die "Gruppierungsvariable". Die Gruppierungsvariable legt die Gruppen fest, die miteinander verglichen werden sollen. Wenn du nun die Gruppierungsvariable, um die es in deiner Untersuchung geht, in das dazugehörige Feld verschiebst, siehst du, dass du noch nicht auf "OK" klicken kannst. Du musst zuvor die Gruppierungsvariable definieren. Da wir es jedoch nicht immer automatisch mit dichotomen Variablen zu tun haben, die bereits als zwei Gruppen vorliegen, ist es manchmal gar nicht so leicht, die zwei zu vergleichenden Gruppen zu definieren.

Wir nehmen für unser Beispiel "Zufriedenheit in der Ehe". Dabei interessiert uns, ob Menschen, die in ihrer Ehe sehr zufrieden sind, weniger fernsehen als Menschen, die ziemlich zufrieden oder nicht sehr zufrieden sind (linksseitiger Test).

Klick' dazu auf "Gruppe def...". Im sich öffnenden Fenster kannst du entweder bei "Angegebene Werte verwenden" die Werte für die beiden Merkmalsausprägungen eingeben, die dich interessieren, oder im unteren Bereich einen Trennwert eingeben, der die Stichprobenwerte unterteilt. Wir machen Letzteres.

Um einen Trennwert eingeben zu können, musst du zuvor in die Variablen-Ansicht gehen und dir ansehen, welche Merkmalsausprägungen es gibt und wie diese kodiert wurden. Das sieht bei "Zufriedenheit in der Ehe" folgendermaßen aus:

Hier sind letztlich nur die Ausprägungen 1 bis 3 relevant (NZ, KA und NA sind fehlende Angaben). Wir setzen nun den Trennwert auf 2, was bedeutet, dass die Gruppe unterteilt wird in Menschen mit der Ausprägung 1, die in ihrer Ehe sehr zufrieden sind, und in Menschen, die entweder Ausprägung 2 oder 3 haben, also ziemlich oder nicht sehr zufrieden sind.

Der Trennwert unterteilt den Datensatz immer in eine Gruppe, die einen Wert kleiner als der Trennwert hat (hier wäre das die 1), und in eine Gruppe, die die Ausprägung des Trennwerts oder eine größere hat. D. h., es werden mehrere Untergruppen zu einer zusammengefasst. Dies ist wichtig, da es beim t-Test ja immer um den Vergleich von zwei Mittelwerten, also von zwei Gruppen geht. Daher muss man einen Datensatz mit mehr als zwei Fallgruppen immer künstlich in zwei Gruppen unterteilen oder nur zwei bestimmte Ausprägungen herausgreifen.

Hätte man beispielsweise nur Frauen (kodiert mit 1), und Männer (kodiert mit 2), im Datensatz, könnte man einfach bei "Angegebene Werte verwenden" definieren, wer Gruppe 1 und Gruppe 2 sein soll und dann entweder 1 für Frau oder 2 für Mann bei der jeweiligen Gruppe eingeben.

Aber nun zurück zu unserem Beispiel: nachdem du den Trennwert 2 eingegeben hast, klickst du auf "weiter" und dann auf "OK". Du erhältst den nachfolgenden Output.

Was du hier ablesen kannst, ist Folgendes:

für hinter die löffelchen:

Bei DEN ÄLTEREN VERSIONEN VON SPSS lässt sich kein einseitiger t-Test berechnen!

Es wird immer ein zweiseitiger Test ausgegeben.

Was tun?

Wenn die Daten bei "Gruppenstatistiken" in Richtung der Hypothese gehen (also hier geringere Fernsehdauer bei den sehr Zufriedenen), kann der p-Wert einfach halbiert werden, um den "wahren" p-Wert für den einseitigen Test zu erhalten.

BEI DEN NEUEREN VERSIONEN ERHÄLTST DU VON VORNHEREIN DIE EIN- UND ZWEISEITIGE AUSGABE & KANNST DANN JEWEILS DEN p-WERT ABLESEN, OHNE IHN TEILEN ZU MÜSSEN.

Einfache lineare Regression

Die Regression ist eines der am häufigsten verwendeten Verfahren innerhalb der Psychologie und dient dazu, aus einer (einfache Regression) oder mehreren Variablen (multiple Regression) eine andere (metrische) Variable vorherzusagen.

Die Vorbedingung ist dabei, dass zwischen dem Prädiktor bzw. den Prädiktoren und dem Kriterium ein linearer Zusammenhang besteht. Dies kannst du dir durch Aufrufen der Korrelationen ansehen. Wie das geht, findest du hier.

Zudem bestehen weitere Voraussetzungen, auf die hier jedoch nicht näher eingegangen wird: normalverteilte Residuen sowie Homoskedastizität (Gleichheit der (Fehler-) Varianzen) – eines meiner absoluten Lieblingswörter! Das heutige Lernziel ist übrigens bereits erreicht, wenn du drei Mal hintereinander flott und fehlerfrei Homoskedastizität sagen kannst.

Eine Erklärung der einfachen linearen Regression findest du hier.

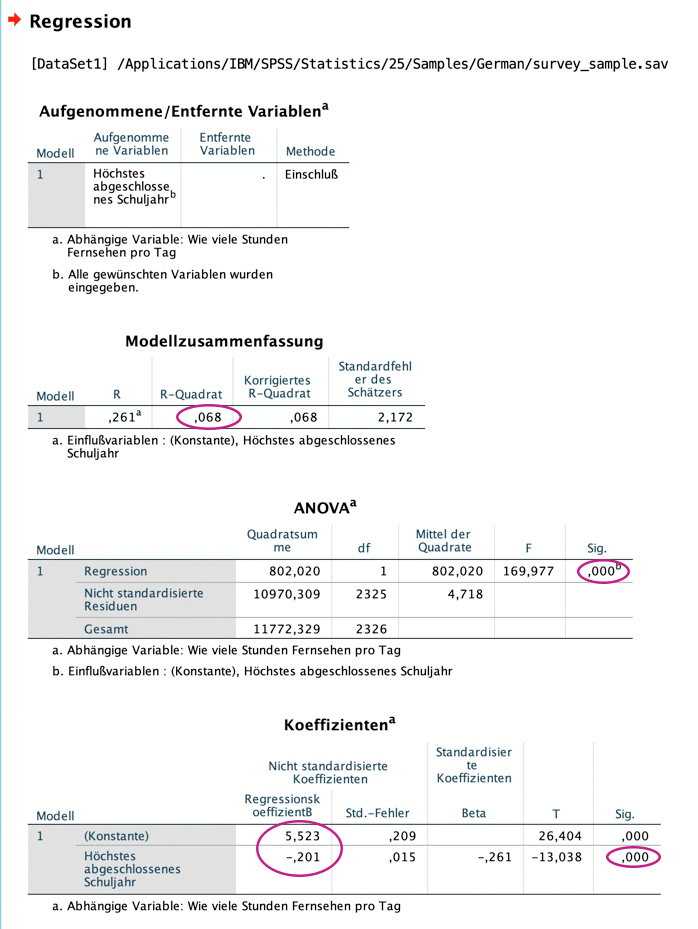

Beginnen wir zunächst mit der einfachen Regression: eine Variable sagt eine andere vorher. Wir machen das nun mit dem bereits bekannten TV-Konsum und wollen diesen aus dem höchsten abgeschlossenen Schuljahr vorhersagen. Also: Lässt sich aus dem höchsten abgeschlossenen Schuljahr vorhersagen, wie lange jemand täglich fernsieht?

Gehe dazu auf "Analysieren", "Regression", "Linear". Im sich öffnenden Fenster verschiebst du "Wie viele Stunden Fernsehen pro Tag" in das Feld "Abhängige Variable". In das Feld "Unabhängige Variable" verschiebst du "Höchstes abgeschlossenes Schuljahr". Wir könnten uns nun natürlich bei "Statistiken" und "Diagramme" alle möglichen weiteren Dinge auswerfen lassen, aber wir beschränken uns darauf, einfach nur auf "OK" zu klicken. Du erhältst folgenden Output:

Brauchst du hilfe beim lernen von statistik?

Dann komm zu Statistik-Gym,

Dem Online-Fitnessstudio für Statistik,

das dich fit für die Prüfung macht!

Statistik-Gym ist eine Mitgliedschaft wie im Fitness-Studio, nur eben für Statistik im Bachelor, die dir hilft, dieses Fach endlich zu verstehen & die Prüfung zu meistern!

Darin bekommst du:

Und dann macht Statistik vielleicht sogar Spaß!

Klingt gut? Dann klick hier:

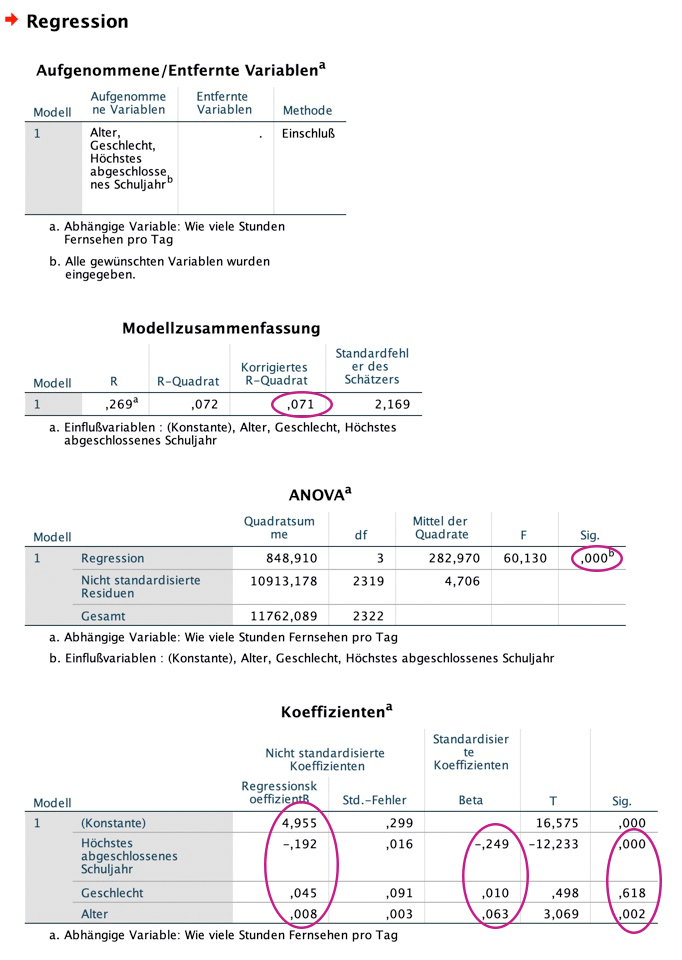

Multiple lineare Regression

Um die sog. Multideterminiertheit des Verhaltens besser abzubilden und mehr Varianz aufzuklären, nehmen wir bei der multiplen Regression weitere Variablen ins Modell auf, denn unser Erleben und Verhalten wird stets von einer Fülle von Faktoren beeinflusst – und nicht nur von einem wie bei der einfachen Regression.

Dabei gilt jedoch das Prinzip der Parsimonität, der Sparsamkeit. Dies bedeutet, dass versucht wird, mit möglichst wenig Variablen möglichst viel Varianz aufzuklären. Ziel ist also nicht, mit 78 Variablen fast 100% der Varianz zu erklären, sondern diejenigen wenigen Variablen zu finden bzw. aus der Theorie, dem aktuellen Forschungsstand abzuleiten, die einen möglichst großen Teil der Variabilität der Werte aufklären.

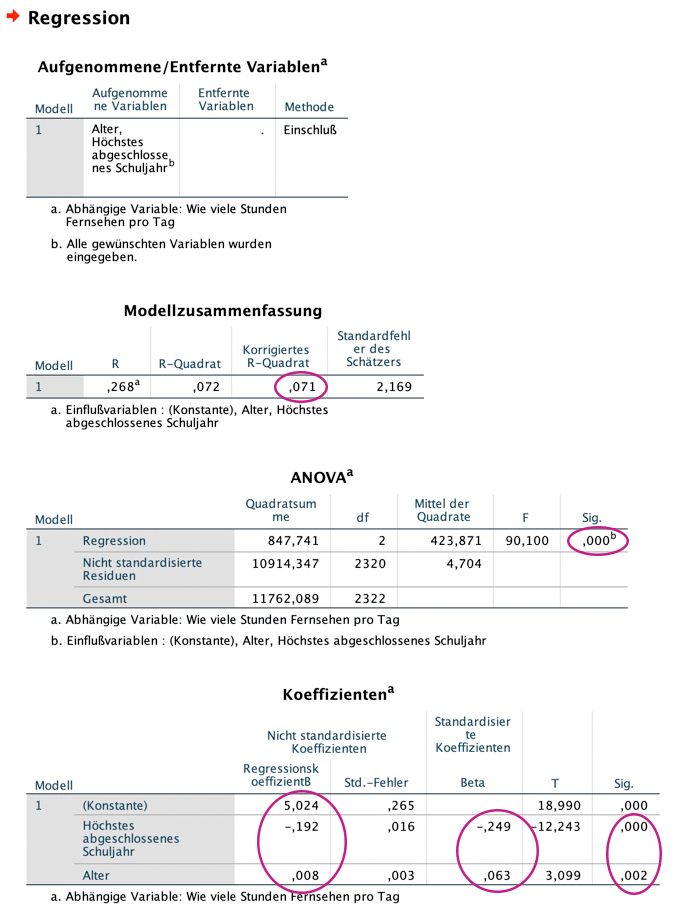

Doch nun zur Umsetzung: Gehe wieder auf "Analysieren", "Regression", "Linear". Im sich öffnenden Fenster verschiebst du wieder "Wie viele Stunden Fernsehen pro Tag" in das Feld "Abhängige Variable". In das Feld "Unabhängige Variable" verschiebst du wie vorher "Höchstes abgeschlossenes Schuljahr" sowie zudem "Geschlecht" und "Alter". Wenn du nun auf "OK" klickst, erhältst du den nachfolgenden Output.

Was du hier ablesen kannst, ist Folgendes:

Geschafft!

Sehr tapfer! Ich hoffe, es fällt dir nun wieder ein Stück leichter, dich in den Ergebnistabellen zurechtzufinden!

Und vielleicht hast du ja Lust, dir gleich einen weiteren Datensatz zu schnappen und das Ganze anzuwenden.

Oder zumindest dreimal hintereinander "Homoskedastizität" zu sagen. Und wenn du das beherrschst, kannst du dich dann an dreimal "Heteroskedastizität" heranwagen.

Jetzt ist aber erst mal Zeit für eine wohlverdiente Belohnung!

Mehr zu t-Tests, der Regression und generell zur Inferenzstatistik findest du in meinem ganz wunderbaren Buch "Schließende Statistik einfach erklärt! Von Null auf Statistik-Profi mit Schritt-für-Schritt-Anleitungen", mit dem du endlich die schließende Statistik verstehst und sogar Spaß dabei hast!

QUELLEN (Bezahlte Links: Als Amazon-Partnerin verdiene ich an qualifizierten Verkäufen):

Bühner, M., & Ziegler, M. (2017). Statistik für Psychologen und Sozialwissenschaftler. Pearson.

Bortz, J., & Schuster, C. (2017). Statistik für Human- und Sozialwissenschaftler. Springer.

Field, A. (2018). Discovering Statistics using IBM SPSS Statistics. SAGE.

Können Sie die Autoren/den Autor bekannt geben? Damit wäre das Zitieren dieses Textes in Arbeiten weitaus einfacher.

Hallo lieber Markus,

alle Blog Posts auf meiner Seite wurden von mir selbst verfasst (Melanie Paul).

Liebe Grüße,

Melanie

Hallo Melanie,

vielen Dank für diesen Text. Hast Du auch einen Text über logistische Regressionsanalysen? Das würde mir sehr helfen.

Danke 🙂

Lg

Marlen

Hallo liebe Marlen,

sehr gerne!

Leider habe ich zur logistischen Regression aktuell noch keinen Text und werde auch so schnell nicht dazu kommen. Tut mir Leid!

Liebe Grüße und gutes Lernen,

Melanie

Hei Melanie

Danke für diese super Erklärungen!

Sie helfen mir enorm weiter, die generierten Outputs aus SPSS richtig zu interpretieren.

Danke dir!

Liebe Grüse und einen guten Rutsch

Ronja

Hallo liebe Ronja,

oh, das freut mich sehr! Sehr gerne!

Wünsche dir ebenfalls einen guten Rutsch in ein wunderbares, gesundes neues Jahr, ganz liebe Grüße,

Melanie

Hallo,

Ich mag Ihre Beiträge sehr.

Ich habe noch eine kleine Frage zum t- Test. Wenn ich mehre t-Tests gerechnet habe und die Ergebnisse miteinander vergleichen möchte, muss ich dann standardisierte Daten verwenden? Oder standardisiert der t-Test schon die Ergebnisse?

Viele Grüße

Angela

Hallo liebe Angela,

vielen Dank für Ihren Kommentar!

Die t-Werte sind gewissermaßen schon standardisierte Mittelwerts-Unterschiede, daher müssen Sie nicht gesondert standardisieren.

Beste Grüße,

Melanie Paul

Vielen Dank für die Erklärungen. Wofür stehen die Werte in der Spalte „T“ zwischen Beta und Sig.?

Sehr gerne, lieber Fabian!

Das steht für die Testung des Regressionskoeffizienten beta auf Signifikanz.

Diese wird mit Hilfe der t-Verteilung durchgeführt, daher siehst du hier ein T.

Liebe Grüße und happy learning!